如果像我一样,你有点失望地得知本月早些时候发布的 Google Gemini 演示更多的是关于巧妙的编辑,而不是技术进步。您会很高兴地知道,也许我们不必等待太久就可以使用类似的东西。

在看过 Google Gemini 的演示和揭示其秘密的博客文章的启示之后。朱利安·德卢卡(Julien De Luca)问自己:“谷歌展示的’双子座’体验是否不仅仅是一个脚本演示?然后,他开始创建一个有趣的实验,以探索类似于双子座演示中描绘的实时人工智能交互的可行性。以下是他对该项目的一些限制,以使其与谷歌的原始演示保持一致。

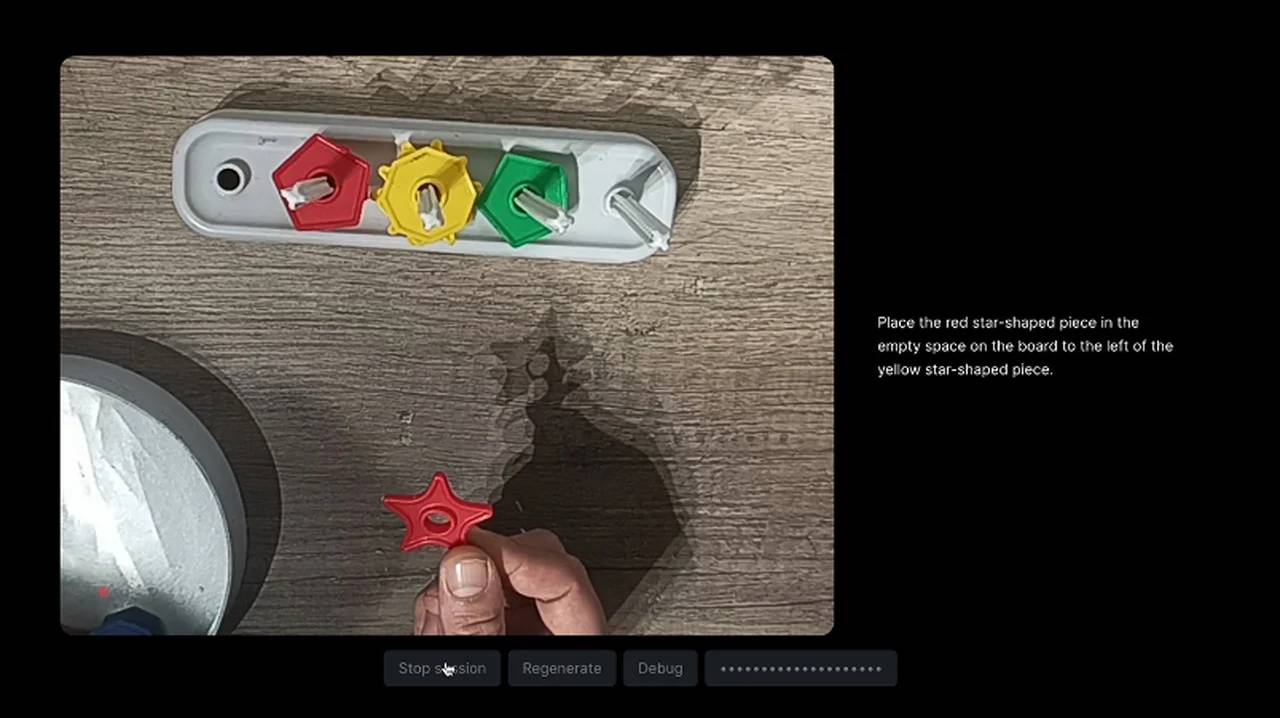

由于 Chat GPT Vision 目前只能接受单个图像,因此 De Luca 需要定期上传从视频中截取的一系列图像和屏幕截图,以便 GPT 了解正在发生的事情。

“咔嚓咔嚓!现在,我们有一个表示视频流的图像。现在我们来谈谈。我需要对系统提示进行大量微调,以使其“理解”这是来自视频。否则,它一直提到“图案”、“条带”或“网格”。我还坚持图像的时间性,因此它会使用图像的顺序进行推理。它肯定可以改进,但对于这个实验来说,它足够好用,“De Luca解释道。若要了解有关此过程的详细信息,请跳转到 Crafters.ai 网站或 GitHub 了解更多详细信息。

创建了真正的 Google Gemini 演示

AI Jason 还创建了一个结合 GPT-4、Whisper 和文本转语音 (TTS) 技术的示例。观看下面的视频进行演示,并了解有关使用不同的 AI 技术组合在一起自己创建一个的更多信息。

为了创建一个集成了 GPT-4V、Whisper 和 TTS 的模拟原始 Gemini 的演示,开发人员开始了复杂的技术之旅。此过程从设置 Next.js 项目开始,该项目是合并视频录制、音频转录和图像网格生成等功能的基础。实现对 OpenAI 的 API 调用至关重要,因为它允许 AI 与用户进行对话、回答他们的询问并提供实时响应。

用户体验的设计是演示的核心,重点是创建一个直观的界面,促进与人工智能的自然交互,类似于与另一个人进行对话。这包括人工智能以适当的方式理解和响应视觉线索的能力。

使用 GPT-4V、Whisper 和 Text-To-Speech 重建 Gemini 演示清楚地表明,人工智能可以通过多种感官理解我们并与之互动的未来正在取得进展。这一发展有望提供更自然和身临其境的体验。人工智能社区的持续贡献和想法对于塑造多模态应用的未来至关重要。

未经允许不得转载:表盘吧 » 使用 GPT4 Vision、Whisper 和 Text-To-Speech (TTS) 重建的真实 Gemini 演示