Zoom已经扭转了一项政策,该政策允许该公司使用客户数据来训练其人工智能(AI)模型。该政策于三月份宣布,遭到了隐私倡导者和用户的强烈反对,他们担心他们的数据将被如何使用。

Zoom希望通过人工智能使其视频通话更加智能,但它也希望拥有为其提供支持的数据。该公司在三月份更新了其服务条款,声称对用户在通话期间生成的数据拥有所有权利。这些数据不仅包括音频和视频,还包括文本、图像和情感。Zoom计划使用这些数据来训练和改进其新的AI功能,称为“Zoom IQ”。

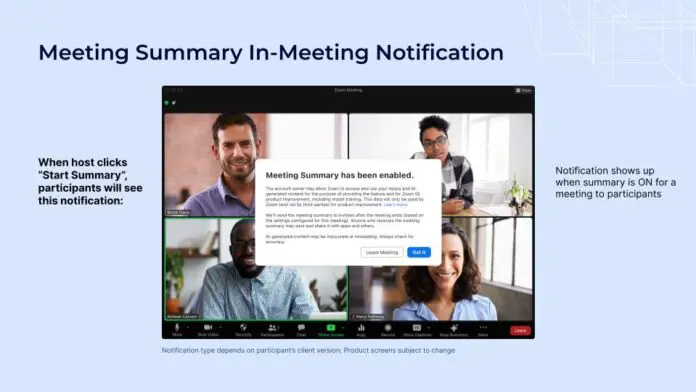

Zoom IQ 是 Zoom 全年推出的一组生成 AI 功能。这些功能旨在增强视频通话的用户体验和工作效率。例如,Zoom IQ 可以自动生成呼叫摘要、转录和操作项。它还可以为用户创建逼真的头像、背景和过滤器。

为了实现这一目标,Zoom使用自己的语言模型,以及由OpenAI和Anthropic这两个领先的AI研究实验室开发的语言模型。Zoom表示,它使用“联合”的人工智能方法,这意味着它不会集中来自用户的数据,而是将学习过程分布在不同的设备和服务器上。

退后一步,扭转决定

在周一的一篇博客文章中,Zoom明确了其政策变更,并做出了以下承诺:“对于人工智能,未经客户同意,我们不会使用音频、视频或聊天内容来训练我们的模型。

根据新政策,Zoom 只会在客户同意的情况下使用客户数据来训练其 AI 模型。可以通过 Zoom 应用程序中的新设置授予此同意。未经同意的客户将不会将其数据用于训练 AI 模型。Zoom表示,新政策将于15月<>日生效。该公司还表示,它将在未经同意的情况下删除任何已经用于训练AI模型的客户数据。

Zoom政策的逆转是隐私倡导者和用户的一个胜利,他们担心他们的数据将被如何使用。这也表明,在最近的数据泄露和隐私丑闻之后,公司开始更加认真地对待隐私。

生成式 AI 隐私问题

聊天机器人和编码工具等人工智能模型如何处理用户数据是一个热门话题。人们担心数据的访问和使用方式,即使是业内最大的参与者也是如此。无论是OpenAI和ChatGPT,Google Bard还是Microsoft的Bing Chat,都有很多关于AI数据采集的答案。

2023 年 <> 月,OpenAI 推出了一个用于 ChatGPT 的插件平台,允许开发人员创建扩展 ChatGPT 功能的插件。但是,最近的证据表明 ChatGPT 插件会导致隐私风险。主要风险之一是插件可用于将恶意代码注入 ChatGPT 会话。这可能允许攻击者窃取数据、安装恶意软件,甚至控制用户的计算机。

未经允许不得转载:表盘吧 » 在隐私问题之后,Zoom 回溯“IQ”AI 数据政策